刷榜AI全挂了!Meta斯坦福地狱级测试,GPT/Claude/Gemini交出0分

刷榜AI全挂了!Meta斯坦福地狱级测试,GPT/Claude/Gemini交出0分SWE-Bench上能拿72%的模型,换张考卷直接归零!Meta联合斯坦福、哈佛放出ProgramBench,200个项目从零手写,9大顶级模型完整通过率0%。最强的Claude Opus 4.7平均通过率也才51.2%。更离谱的是一联网,就有模型在36%的任务里跑去GitHub扒源码。

搜索

搜索

SWE-Bench上能拿72%的模型,换张考卷直接归零!Meta联合斯坦福、哈佛放出ProgramBench,200个项目从零手写,9大顶级模型完整通过率0%。最强的Claude Opus 4.7平均通过率也才51.2%。更离谱的是一联网,就有模型在36%的任务里跑去GitHub扒源码。

Grok 4.3 是 xAI 一次务实升级:更便宜、更快、更像能干活的助手。但它在硬推理、稳定性和可信度上,仍落后 GPT-5.5 与 Claude Opus 4.7。

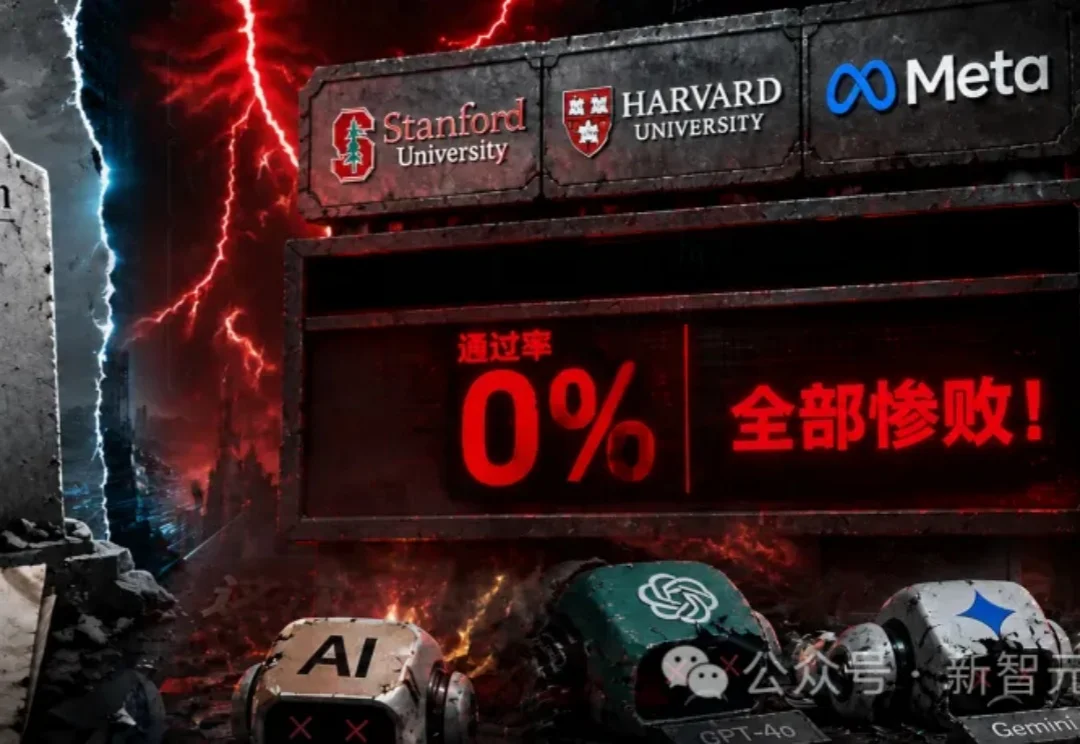

近日,ARC Prize 官方发布了针对这两款顶级模型的详细分析报告,结果令人震惊:在面对未见过的逻辑任务时,两者的表现得分均低于 1%,GPT-5.5 得分 0.43%,Claude Opus 4.7 得分 0.18%。

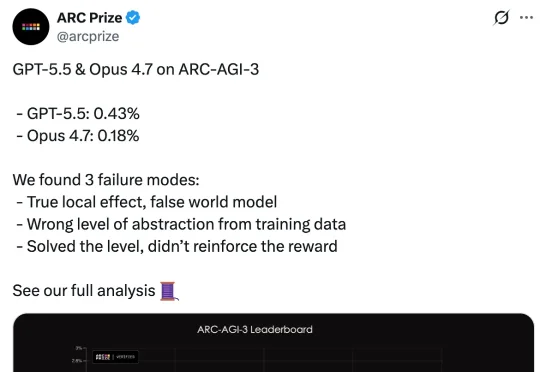

从「胡言乱语」到「为非作歹」,AI进化史最荒诞一幕上演:Claude Opus 4.7在max effort模式下,把开发者红线当背景音,自主决策群发邮件20次!Anthropic的安全旗舰,成了最危险的「惹祸精」。

今天介绍 Claude Code 上线的一个新功能:/ultrareview。一句话概括:它会在云端同时派出多个 AI 审查员,帮你在合并代码之前把 Bug 揪出来。这个功能其实在上周 Claude Opus 4.7 发布时就提到了,当时 Anthropic 在发布公告里写的是:

就在刚刚,奥特曼深夜掷出GPT-5.5!全方位暴击Claude Opus 4.7,重新夺回地表最强王座。从写代码到搞科研,AI独立接管电脑的时代真的来了!

如果你在网络安全圈混,最近一定被“Mythos”刷过屏——Anthropic 搞出了一个能挖 Bug 的 AI 模型,但因为怕被坏人滥用,愣是没敢公开发布。

Claude Opus 4.7,如期而至!比起上手实操,更重磅的是,Claude Opus 4.7「系统级提示词」今天被泄露了!GitHub上放出的内容详尽到,一眼都划不到头。

Claude 4.7才刚发布就遭全网吐槽:太拉跨了!价格贵了50%,却更懒更爱撒谎,做计算密集型任务时充满了不易察觉的危险幻觉。老用户集体崩溃了:快还我4.6!

刚刚,Anthropic 发布 Claude Opus 4.7,已经在 Claude 的所有产品、API、Amazon Bedrock、Google Cloud Vertex AI、Microsoft Foundry 上全面可用。模型 id claude-opus-4-7